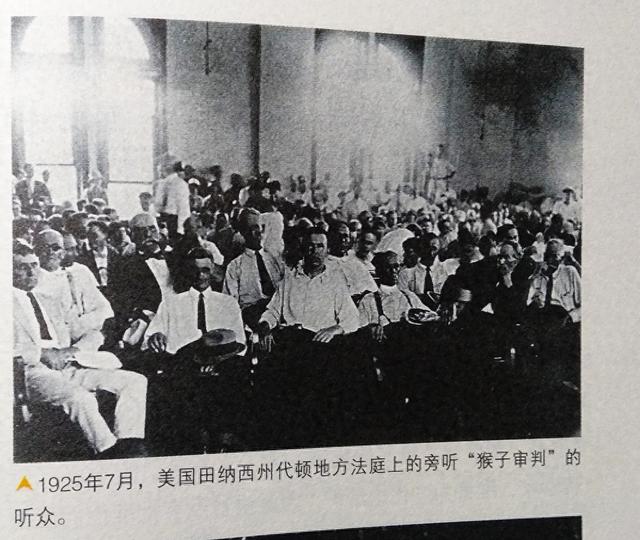

20世纪20年代,美国先后有三十七个州的议会收到了一份让人哭笑不得的法案,被媒体戏称为:猴子审判法案。法案称:凡是接受洲公立教育基金资助的公立学校,都必须禁止在学校向学生讲授进化论。而这份法案的提起人,是一个牧师,他向议会提出法案的原因竟然是:因为他们教会的一个女孩,上完了大学后,就不相信人是上帝造的了。

牧师在法案中称:让公立学校的学生学习进化论妨碍了他们的信仰和社会价值认知,科学家信不信上帝不重要,但是公立学校的普通民众必须树立正确健康的价值观,而不是进化论的那套“弱肉强食”“优胜劣汰”“适者生存”的有悖伦理和博爱的观念。

这一通言论,瞬时间把人们带回了六十多年前的牛津论战,人类到底是不是进化来的这个话题又冲上了”热搜“第一。而且,万万没有想到的是,这么一个荒唐的提案还真的在几个州通过了。

当然,这个“猴子审判”提案的热度在大部分州都没能掀起太大的讨论,因为很快人们的注意力被一个新的东西吸引,人类发明了:计算机。那进化和人类发明计算机,又有什么关系呢?

电脑会不会超过人脑?随着计算机的发明,几乎同时就有一小部分人意识到了未来人工智能的出现,并且坚信它必定会在智力上甚至各个方面超越人类,从而他们想到了一个可怕的问题,假如那天来临,人类在这些智力更高的机器眼里,会是怎么样的存在?会不会就如人类看待原始人一般,它又会如何对待智力更弱后的人类?

想到这个问题的人们,迫切需要搞清楚一个问题,那就是这种情况会不会出现,而要搞清楚这个问题,首先人们就要搞清楚人类的自我意识是怎么出现的,假如正如主流科学所认为的:人类是在海量学习和积累中获得的自我意识,那么将来,人工智能是否也会通过这样的方式觉醒自我意识,成为真正的“人”?

而同样几乎在人们意识到这个问题,开始思考这个问题的同时,已经有一个人破天荒的预言了它的必然性,他认为人工智能未来一定会超越人类,也一定会觉醒自我意识,他就是鼎鼎大名的有着好多“家”头衔的:计算机科学家、数学家、逻辑学家、密码分析学家、理论生物学家、计算机之父、人工智能之父的图灵。

图灵有多牛呢,可以说他影响了后来许多的科技界大佬,影响了第二次世界大战的进程,甚至他的死都充斥着是被英国政府迫害的阴谋论,这里我们就不展开说了。

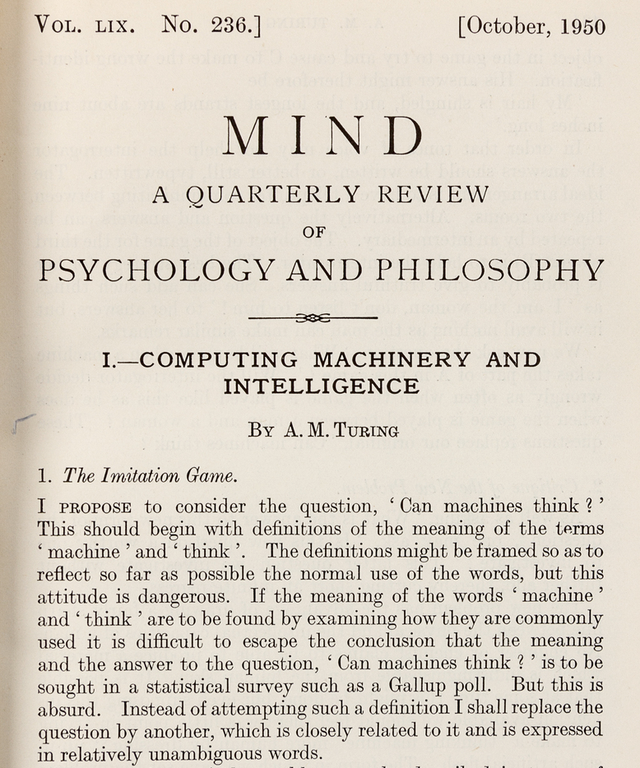

1950年,在人类的第一代计算机刚出现不久,图灵在他的论文:《计算机器与智能》开篇就提到了一个概念:如果一台机器输出的内容和人类大脑别无二致的话,那么我们就没有理由坚持认为这台机器不是在“思考”。

而这个被动完成和主动思考的区别,举个例子,假如你是一个做饭的机器人,你是在得到了主人告诉你,今天吃什么之后被动完成,还是进一步,根据从主人的饮食偏好、营养等一系列数据分析中得出今天应该做什么,还是最终的主动思考今天做点什么。

前者就好比你现在的电脑、其次就是现在的人工智能,而最终的那个会主动思考的,则是我们人类,但是早在那时,图灵就认为未来的人工智能必然会是第三种,甚至超越人类。

当然这就有一个前提,就是按照这个推测,人工智能必然会进化出自己的意识,这个我们后面说。

而为了防止出现这一情况,图灵设计了一套用于测试人工智能是否可能出现了自我意识的办法,也就是著名的图灵测试。

人工智能的“照妖镜”-图灵测试图灵测试简单来说,就是将一个人、一个机器分别安置在不同的房间,随后观察者在看不到房间内的情况下通过打字的方式分别提问,从而来分辨哪一个房间的是机器,哪一个房间的是真人,只要有30%的人被机器误导,那么机器就算是顺利的通过了测试。

但是按照这个方法,人们是很容易分得出哪个房间里的是真人,比如说你同时向两个房间反复问:你会下象棋吗,反反复复之后真人的房间一定会不耐烦,当然不只如此,还有很多方法可以测试出哪个房间的是机器,因为如果想要制造出能通过试验的机器,必须在电脑中储存人类所有可以想到的问题,还有对这些问题的所有合乎常理的回答,并且还需要理智地作出选择,然而人类往往有时候不按常理出牌,也不会像机器那样理智,比如我说三连支持一下,机器就不会说出下次一定这样的回答。

类似的测试也被用在许多地方,比如我们现在经常要输入的验证码,一定程度上也是区别人和机器的一种图灵测试,但是随着如今机器的愈发智能,为了能准确分辨,验证码也变得越来越复杂,比如大家可以试试这个几个。

当初,图灵在提出这套测试的几乎同时,他也预言,到2000年左右人类就可以设计出超越图灵测试的人工智能,而事实上也正如图灵所预言的,2014年6月7日的图灵测试大会上,由俄罗斯的开发团队开发的一个名为:尤金.古斯特曼的小男孩人工智能聊天机器人,就成功突破了图灵测试,因为它让与他聊天的观测者很难分辨,一些不合逻辑的回答,到底是一个13岁小男孩的调皮之举,还是机器,因为就像我们刚才说的,理论上机器不可能做出与提问无关的回答。

但是问题是,就算人工智能突破图灵测试,就真如预言所说的那样,离它们觉醒自我意识不远了吗?也有许多科学家不那么认为,比如加州大学伯克利分校教授约翰.瑟尔就反对这个观点。

他认为,担心人工智能产生自我意识是完全没有必要的,人工智能能否产生自我意识取决于它有没有目的性、能否意识到自我,而被人类设计制造出来的机器,显然不可能有目的的,有也是人类的目的,它所谓的智能,只不过是人类为了它看起来更智能。

于是为了反驳图灵测试,它提出了一个名为中文房间的思维实验。

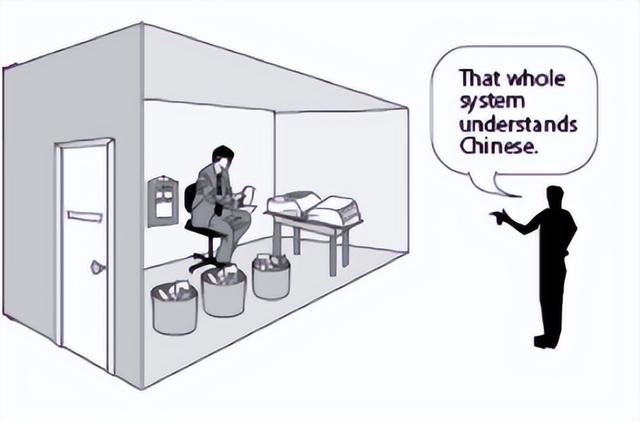

实验是这样的:假如有一个完全不会说中文的老外被关在一个封闭的房间内,而这个房间里有一本无比详细的《中文回应词典》,假设这本词典上包含了所有问题的答案,但是却并没有解释这些问题和答案的意义,此时,门外另一个人用中文在纸条上写上各种问题,通过门缝塞进去,那么里面的老外就可以根据词典找到每一个问题的回复,然后写完了塞出来。

那么这时候,门外的人一定以为,门内的老外会说中文,但是显然门内的老外根本不知道外面的人问了什么,自己回答了什么,只是根据词典的标准答案回复而已。

同理,把门内的人换成人工智能,词典好比它的程序,即使这个程序牛到将有人类开始所有一切的语言逻辑全部收纳进去,即使它通过了图灵测试,骗过了所有人,但是它依然是根据程序来进行回答,而不是真的拥有了自我意识。

而人类则不一样,比如我问你吃了吗,你可以不理我,你可以岔开话题,甚至可以说关我什么事,是吧,所以它是没有一个标准答案的。

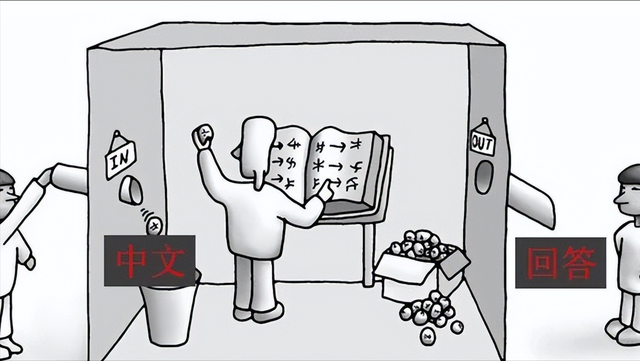

瑟尔的这个结论一经发布,立刻受到了反驳,反驳者认为这个结论并不严谨,刻意把“中文词典”“不会中文的老外”“房间”拆分为三个独立的存在,而实际上当他们同时出现,就应该被视作为一个整体,而作为一个整体显然它就知道自己回答了什么,是有意识的。

举个例子,老外好比你这个人,词典好比你的自我意识,房间好比你的大脑,你们是一个整体,而这个测试则硬生生把这三者分开,许多个体单独存在可能没有意义,而作为整体则会产生意义,所以这个结论并不能说明什么,是一个不严谨的结论。

而面对反驳自己结论的反驳,瑟尔又反驳提出:那就按你们说的,作为一个整体来看,假如这个老外硬生生记下了词典上所有的内容,并且走出了房间,那么这就可以看作为“中文词典”“老外”“房间”的一个整体了吧,这时候他面对门外的提问者可以当面给出回答,让对方认为这个老外会中文,但其实他即使作为了一个会中文的整体,他还是不懂中文的,因为词典上并没有含义,所以他还只是根据你的问题,自动回答了对应的答案。

于是,反驳者又根据瑟尔的实验修正,提出了新的反驳称:假如这个老外记下了词典的所有内容,并且能够回答提问者一切问题,作为一个整体他就可以算作有了自我意识,因为人的意识是人类自己的主观概念,我们认为我们是智慧的,但其实我们的智慧来自于大脑的每一个脑细胞之间的电信号转换,每一个电信号只是负责简单做着传递、抑制、缓冲的工作,而实际上,就是如此简单却庞大的工作,却产生了人类的自我意识。不然按照瑟尔的说法,难不成每一个脑细胞都必须是一个有智慧的个体吗?那脑细胞的智慧又从是怎么来的,由无数有智慧的有智慧的,脑细胞的脑细胞组成吗?

看到自己又被反驳了,瑟尔又反驳了对方的反驳,认为对方无理取闹,第一,目前没有确切的证据证明人类的自我意识就是单一产生于单个脑细胞之间组成的庞大电信号链接,而对方却一味的把单个脑细胞与产生自我意识做了直接类比,1个脑细胞不能理解中文,10个、100个就能莫名其妙理解了吗?这种类比丝毫没有价值。

于是,反驳者又继续反驳了瑟尔反驳自己反驳的观点,这双方之间的反驳到现在也还没有定论。其实双方各自站的立场可以追溯到牛津论战,甚至更早的唯心唯物,双方围绕的问题根本其实是:人类的自我意识到底是不是客观存在的。

反驳者认为,假如一台人工智能能够理解人类所有的问题,包括人类不按常理出牌的对话逻辑、解读和学习人类所有的情绪,那么它就可以被认为,是拥有自我意识了。

举个例子,忘了在哪个书里看到的了,好像是《原始感应》,你看到了你喜欢的人,你感觉很开心,这是一个因果关系对吧,因为你喜欢他,所以你看到他很开心,那问题来了,这个”“开心”可以反映在大脑中被捕捉到吗?

结论是可以,人类的情绪变化,哪怕你刻意隐藏了,但是依然可以通过脑电图捕捉到,所以应该是:你喜欢这个人,你看到了他,随后大脑产生了反应,这个反应使你感觉很开心。

所以假如人类彻底搞清楚了之间的原理,那么也可以将这一原理设计在人工智能上,所以一个被人类植入所有人类条件的人工智能,它就是一个被植入了”灵魂“的真正的人。

他们认为,因为在人类目前行为主义心理学和认知科学上,人类的自我意识这个东西不是客观在的,注意我们说的是意识的独立存在,而只是一个分辨主体和客体的客观错觉。

所以并不能因为机器不知道自己在干嘛,就认为它不具备自我意识,而且当它有了和人类一摸一样的“大脑”后,你怎么知道它不知道自己在干嘛?

当然关于这个问题还牵扯到基础欲望,但是这个不在此次争论中,所以我们就不说了。

而这其实就是瑟尔和反驳者的争论点,那么假如一台人工智能在看这个视频,它能不能意识到自己在看视频呢?而能否意识到”自己“在看视频,就决定了人工智能是否可以存在自我意识,而他们显然认为是可以的,至少在未来。

反驳者认为,人类之所以能产生“自我”这个概念,前提是由于我们大脑的神经元以及突触广泛链接构成了一个整体,再通过不断地学习、积累、社会行为从而形成的,但是本身来说它并不复杂,假如人类搞清楚了大脑的一切,理论上只要我们想,我们当然可以创造出一个硬件上和我们一摸一样的人工智能,那么它通过不断地学习、积累、人工智能与人工智能、人工智能与人类之间的社会行为,当然可以诞生自我意识。

要不然难不成人类有什么与众不同的特殊吗?如果你认为人类搞清楚了一些有关大脑的原理,还是不能设计出一个有自我意识的人工智能,那你就和那些相信人类具有所谓“灵性”的唯心主义者一样了。

所以如果刚才你支持的是反驳者的观点,那么你和许多科学家的观点相同,早在2014年,霍金在接受媒体采访时,就曾表示: “制造能够思考的机器无疑是对人类自身存在的巨大威胁。当人工智能发展完全,就将是人类的末日。”所以霍金也认为,人工智能是可以通过和人类一样的大脑演化方式从而获得自我意识的,与之相同的还有奇点大学联合创始人、谷歌技术总监雷·库兹韦尔(Ray Kurzweil),并且他认为按照如今人工智能发展的速度,这一天,就在2045年,第一个诞生自我意识的人工智能将会出现。

但是这里有个前提,能造出来和要不要造不是一回事,这一派都认为当人类完全搞清楚大脑,那么就可以造出来,但是比如霍金就反对人类去制造这么一个会自我思考的人工智能。

而相反的,瑟尔的观点认为即使一个再聪明的机器,也是机器,即使人类的可以将从出现猿猴到如今,所有一切的预言、文字、历史文化、哲学、数学、物理,所有所有一切相关知识都输入到一个人工智能的程序中,纵使它已经被人类只能千倍万倍,它依然不可能诞生自我意识,因为它的原理依然是如那个房间里不会中文的老外一样,是基于人类输入的知识为前提,本质上还是一个对答机器,哪怕它可以举一反三,从这些知识里自我学习。

举个例子,比如“阿尔法狗”,即使它可以下赢世界围棋冠军,即使它可以通过自我学习程序不断提升,但是它就不可能像人类一样从围棋种悟出什么哲学,所以再聪明它也还是一台机器,所以人类大可不必担心未来人工智能的问题,那永远都是科幻,不是科学。

如果刚才你支持的是瑟尔的观点,那么你就和许多唯心主义的思想家观点一致了,他们都认为人类意识的产生,并不是一套严格的科学原理或机械原理可以解释的,人类即使将来把大脑摸透了,也造不出一个有自我意识的“人”。

而有意思的是,图灵测试与中文房间这两个不同观点的对弈,反而回到了节目开头我们所说的闹剧上,唯物和唯心关于-人类的意识是否是在自然演化过程中诞生的这个问题上,立场对调了。

这次反而是当初反对“人”是被创造的那部分科学家,却试图间接试图证明“人”可以被创造,因为假如,未来人类真的创造出了诞生了意识的人工智能,而人工智能也如霍金所预言的会毁灭人类,人类灭亡的若干年后,脑洞大开一下,新的“人工智能人类”会不会有一个神话故事:当初一部分神(人类)创造了人(人工智能),盗取了天火-(智慧)带给他们,发现后的神(人类)降下灾难,企图消灭拥有了智慧的人(人工智能),而最终人类(人工智能)毁灭了神,那这样普罗米修斯的剧情不就闭环了,人类的神话故事闭环了。

既然证明了人可以创造新的“人”,那我们又有没有可能真的也是被造的?

反而,当初被诟病的那些唯心思想、被认为是边缘科学、甚至神棍的那些,比如我们之前节目说的彭罗斯、李嗣岑、史威登堡等……反而站在了否定的阵营里认为“人”是不可以被创造的,他们都认为人的意识本身就是客观独立存在的,意识世界和物质世界是相互独立存在的,物质不可能创造精神,精神也不可能创造物质,它们就好比一阴一阳,组成全部的宇宙,所以人类科学发展到逆天的程度,那也是物质世界的,不可能去创造一个精神世界中的东西出来。

无论是我们上期节目所说的彭罗斯认为的意识是产生于量子层面,是构成宇宙的物质之一,还是李嗣岑认为的意识是虚数空间对实数空间的投射,感兴趣的小伙伴在主页搜一下可以找到。

当然了,能和不能,这一切都只是假设,甚至你还可以找出第三个说的过去的理由,比如回到刚才的问题,也许我们认为的生命形式,只是我们主观认为的,假如人工智能真的觉醒自我意识,它会是一种没有基础欲望的、我们暂时无法理解的新的生命形式,就好像活在互联网里的贞子一样。

好了本期节目就到这里,喜欢别忘了三连支持一下,下期见啦。