作者 | 骆展鹏

来源 | 科技每日推送(ID:apptoday)

当全世界科技公司都在挥舞钞票,疯狂抢购H100时,英伟达突然上架新品。

北京时间3月19日凌晨,被誉为“AI春晚”的英伟达GTC 2024如期而至。

身着标志性皮夹克黄仁勋站在舞台中央,平静地甩出“核弹”级超级芯片。

谈笑风生间,再次将 AI 芯片的标杆,推到了难以想象的高度。

重新定义摩尔定律

“通用计算已经失去动力,现在我们需要更大的模型,我们需要更大的 GPU,更需要将 GPU 堆叠在一起。”

黄仁勋这句话,可以说是贯穿发布会的主线。

本次发布会的主角,当属采用 Blackwell 架构的 B200 和 GB200 系列芯片。

老黄自信表示,这是英伟达史上最成功的产品。

与之前的产品相比,他最大的特点就是——大。

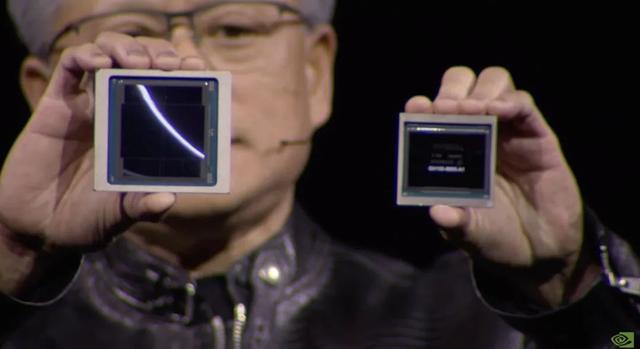

Blackwell(左)与 Hopper GH100(右)

台积电4nm制程突破不了怎么办?

那就把两块芯片“黏”在一起!

Blackwell 是英伟达首个采用 MCM(多芯片封装)设计的 GPU,在同一个芯片上集成了两个 GPU。

这种用“胶水”缝合的做法,类似于苹果的 M1 Ultra,库克直呼内行。

只不过,英伟达的做法更极端。

Blackwell 芯片之间以10TB每秒的满血带宽互联,组成B200 GPU,总计包含2080亿晶体管。

相比之下, H100/H200 只有 800 亿个晶体管,足足翻了一倍多。

更离谱的是,两块B200还能进一步“合体”,与 Grace CPU 融合,就是进化体—— GB200。

随后,黄仁勋端出了产品,并调侃道:“我现在一手拿着 100 亿,一手拿着 50 亿。”

不得不说,在芯片工艺制程触及边界今天,升级算力的唯一方法只剩拼接了。

按照老黄的说法,GB200 可以为大语言模型(LLM)推理负载提供 30 倍的性能提升,并将成本和能耗降低高达 25 倍。

在标准的1750亿参数GPT-3基准测试中,GB200的性能是H100的7倍,提供的训练算力是H100的4倍。

这AI性能,何止遥遥领先,简直恐怖如斯!

Blackwell 的发布意味着,近八年来,AI 算力增长了一千倍。

不少网友表示:摩尔定律,又复活了。

就连英伟达高级科学家Jim Fan也惊呼:性能野兽来了,新的摩尔定律已经诞生!

一个机柜

抗衡超级计算机群

当然,GB200还不能满足你的需求的话,加钱就能变得更强。

两个GB200芯片装到主板上,就是一个Blackwell计算节点。

如果你恰好财力雄厚,购买18个这样的节点,就能拥有36CPU+72GPU组成的巨型“虚拟GPU”。

在NVLink Switch技术支持下,最终成为“新一代计算单元”——DGX GB200 NVL72。

它的重量高达 3000 磅(约 1361 公斤),拥有 5000 条 NVLink 电缆,长达 2 英里。

由于发热巨大,采用了液冷散热的方式。

这样一个看似平平无奇的“机柜”,FP8精度的训练算力就高达720PFlops。

要知道,上一代的H100,一个DGX SuperPod超级计算机集群,算力也只有1000 PFlops。

如今,只需一个“机柜”即可抗衡~

不仅如此,这次英伟达还将算力上云了。

DGX SuperPOD 由 8 个或以上的 DGX GB200 系统构建而成,这些系统通过 NVIDIA Quantum InfiniBand 网络连接,可扩展到几万个 GB200 超级芯片。

用户可通过 NVLink 连接 8 个 DGX GB200 系统中的 576 块 Blackwell GPU,从而获得海量共享显存空间,来训练下一代 AI 模型。

更形象一点,这就是AI时代的赛博蒸汽机。

老黄直言,“英伟达DGX AI超级计算机,就是AI工业革命的工厂”。

他还举了个例子,OpenAI 最新的 GPT-4-1.8T 的参数规模,上一代Hopper GPU需要 8000 张,耗时90天才能完成。

同样的工作量,如今2000 台 Blackwell 花费 90 天就可以完成训练。

无论是电力还是成本都只有原来的四分之一,能耗与训练效率更是提升了 25 倍。

简单来说,不仅变强了,还更环保了。

最后

“即使竞争对手的 GPU 是免费送的,客户也不会考虑。”

前几天黄仁勋在斯坦福演讲时,留下了这么一句话。

当时,这句话引来了不少争议,有人觉得老黄飘了。

不过,相信 GTC2024 结束后,没有人再会质疑他。

因为英伟达卖的不是显卡,而是为客户提供了一整套的解决方案。

如今的英伟达,已然是一家平台公司,只要涉及 AI,一定绕不开它。

包括 OpenAI 在内,亚马逊、Google、微软以及Meta,都是 GB200 的首批用户。

此前,英伟达通过H100、H200 芯片,缔造了万亿AI帝国,市值超越了亚马逊等传统豪强。

今天发布的B200、GB200能否再创奇迹,扩大其领先地位,我们暂时不得而知。

但科小编相信,看完发布会后,最紧张的应该是苹果吧?