一时间,我们仿佛回到了20多年前那个互联网兴起的时代。近来,随着GPT-4、百度文心一言等大语言模型竞相登场,一场由ChatGPT点燃的AIGC浪潮正悄然掀起一场重塑数字内容生产方式的科技革命。

但你有没有想过,随着AIGC应用加速渗入到各行各业,不断推动参数量更大、迭代时间更长的AI大模型演进,这背后除了对算力需求持续提升,更对AI集群的网络通信性能提出了更加严苛的要求。

那面对AIGC拉开变革序幕,作为“幕后英雄”的AI集群网络,如何与时代的潮流一同跃进?

AIGC背后的AI集群网络瓶颈

为什么高性能的AI集群网络通信对于AIGC应用非常重要?对于以ChatGPT为代表的AIGC应用,背后起关键作用的是大语言模型,其由深度学习神经网络对海量数据进行训练,需要大量的训练样本和模型参数,对算力要求极高。以GPT-3为例,训练数据集是超过45TB的互联网文本,参数规模达1750亿;为训练如此复杂的神经网络,据报道GPT-3在微软Azure AI超算基础设施(由1万块V100 GPU组成的高宽带集群)上进行训练,总算力消耗约 3640 PF-days(即每秒一千万亿次计算,运行3640天)。

显而易见, AI大模型算力消耗惊人,单一计算设备已远远无法满足模型训练的算力需求。为提供强大的算力,提升训练速度,利用AI集群进行分布式深度学习训练已成为首选。然而,尽管分布式训练通过多个GPU节点并行训练,可减轻各个计算节点的压力,但不同节点之间需频繁地同步模型参数,会产生网络通信开销,让网络通信性能成为制约系统性能的新瓶颈。且随着AIGC应用快速发展,模型参数数量不断跃升,神经网络越来越复杂,AI集群的GPU节点数持续增加,瓶颈将越来越突出。

比如,分布式深度学习训练的并行方式主要分为数据并行和模型并行,在数据并行模式中,深度神经网络模型被复制到每一个GPU节点,训练数据被分散分配到不同的GPU节点,每轮迭代后都要通过All-Reduce操作同步和汇总各个GPU节点在本地产生的梯度,以更新全局模型参数,供下轮迭代使用。在这个过程中,不管是拉取数据样本还是GPU节点间进行模型参数同步,都需要高性能、低时延的网络为基石。一旦网络性能不佳,就会影响分布式训练的质量和速度。

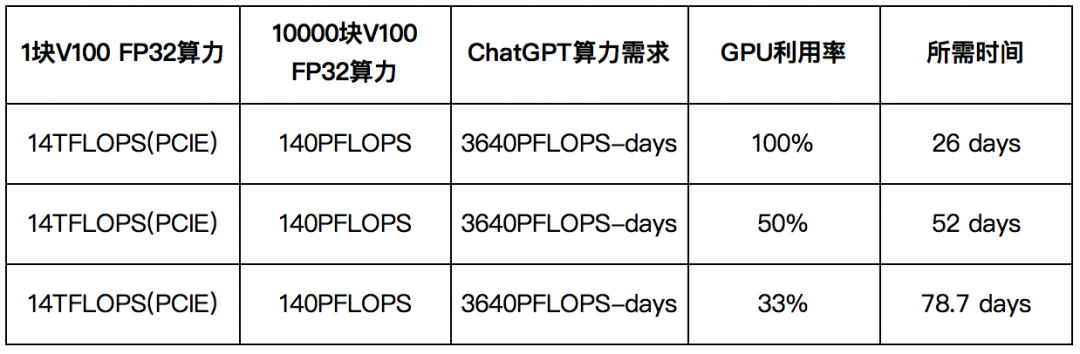

按GPT-3在由1万块V100 GPU组成的高宽带集群上进行分布式训练计算,如下表,若GPU利用率为100%,训练时间需26天。若GPU利用率为33%,训练时间则需要78天。可见,GPU利用率是影响AI大模型训练速度的主要因素。而影响GPU利用率的关键因素之一就是网络通信效率。

究竟哪些因素决定了网络通信效率?主要包括节点间通信带宽、节点内通信带宽、交换设备转发时延、端处理时延、内部排队时延和丢包重传时延。

其中,节点间通信带宽、节点内通信带宽、交换设备转发时延这三个因素取决于硬件性能,端处理时延取决于网络协议选择,而内部排队时延和丢包重传时延由网络拥塞导致,受网络优化和技术选择的影响。因此,抛开硬件性能的限制,针对端处理时延、内部排队时延和丢包重传时延三大动态因素优化网络拥塞和时延,是提升AI集群网络通信性能最具成本效益的方法。

传统HPC组网面临诸多挑战

针对影响AI集群网络通信性能的动态因素,业界已采用RoCE v2网络协议、PFC和ECN机制、ECMP等关键技术来进行HPC组网。但在实际应用中,这些技术都不同程度地暴露出不少问题。而随着AIGC应用持续升温, AI大模型训练的算力需求持续提升,这些问题将越来越突出,提升网络通信性能的迫切性也越来越高。

为提升分布式训练速度,当前的分布式深度学习训练系统通常采用RDMA(远程直接内存访问)技术,其具有内核旁路、零拷贝的优点,可绕过操作系统内核,直接在内存间传送数据,从而能大幅提升系统吞吐量,降低通信时延。

RDMA技术最早用于IB(Infiniband)组网,以通过构建无损网络实现HPC高性能计算集群的互联。不过,由于IB组网采用专有网络协议栈,存在技术封闭、兼容性低、单一厂商垄断等问题。为此,业界将RDMA技术移植到以太网上,推出了基于以太网的RoCE(RDMA over Converged Ethernet)协议,并将之演进到RoCE v2版本,从而推动了RDMA技术普及。

为实现无损以太网,基于RoCE v2网络协议的网络方案定义了PFC和ECN两大必选机制,以消除网络拥塞,确保数据不丢包。PFC能够逐跳提供基于优先级的流量控制,缓解网络拥塞,规避丢包。ECN可消除网络拥塞,最大限度减少PFC反压。但在多级PFC组网下,当网络中出现大量PFC反压帧时,会诱发网络死锁(PFC DeadLock),严重时会导致整个网络阻塞。ECN毕竟依靠降速发送来实现,会降低通信带宽,对GPU利用率产生较大影响,进而拉低整个网络的算力。

同时数据中心网络中通常使用的ECMP(等价多路径)路由策略也不是最理想的负载均衡方案,其将数据流分发到多条路径上并行转发到同一目的地地址,以充分利用网络中大量冗余路径,实现流量均衡分配和链路备份,但对于多条大象流(字节数大的数据流)可能会造成Hash路径上的数据流碰撞,从而导致一些ECMP成员链路拥塞,而另一些链路相对空闲的情况。

对此,海外有部分互联网公司寄希望于利用采用DNX芯片支持VOQ技术的框式交换机来解决负载不均衡带来的带宽利用率低的问题。但问题又来了,传统框式交换设备将接口板卡、交换板卡、控制引擎等软硬件集成于一个物理机框中,插槽、端口数量受限于机框大小,导致转发容量有限,如果想做更大规模的集群,需横向扩展多个机框,不仅存在扩容成本高、运维成本高等挑战,而且会产生多级PFC和ECMP链路。

锐捷网络率先推出“智速DDC”高性能网络方案

面对以上挑战,锐捷网络推出了业界领先的“智速DDC”高性能网络方案,并计划于今年推出两款可交付产品,分别是400G NCP交换机和200G NCF交换机,为AIGC打通“任督二脉”。

DDC(Distributed Disaggregated Chassis,分布式分散式机箱)是一种分布式解耦机框设备的解决方案,它将传统软硬一体的框式设备的组件进行拆解,以NCP替代传统框式设备的线卡板,以NCF替代交换网板,并通过光纤互联替代原先两者之间的连接器组件;传统框式设备的控制管理引擎也独立出来,可以以软件化的方式灵活部署于任何一台标准服务器或多台服务器,能有效节省部署成本,提升系统冗余性和可靠性。

DDC方案突破了传统框式设备的资源限制,让大规模组网化繁为简,不仅具有扩展弹性、扩容升级快、单机功耗低、运维管理效率高等特点,可灵活支持AI集群大规模部署,而且具有集群路由设计简单、数据转发方式更优化等优势,能有效提升网络通信性能。

在支持AI集群超大规模部署方面,在单POD组网中,采用96台NCP作为接入,其中NCP下行共18个400G接口,负责连接AI计算集群的网卡。上行共40个200G接口最大可以连接40台NCF,NCF提供96个200G接口,该规模上下行带宽为超速比1.1:1。整个POD可支撑1728个400G网络接口,按照一台服务器配8块GPU来计算,可支撑216台AI计算服务器。

在多级POD组网中,可以实现基于POD的按需建设。考虑该场景POD中NCF设备要牺牲一半的SerDes用于连接第二级的NCF,单POD采用48台NCP作为接入,下行共18个400G接口,单POD内可以支撑864个400G接口。通过横向增加POD实现规模扩容,整体最大可支撑6912个400G网络端口。

NCP上行40个200G接POD内40台NCF,POD内NCF采用48个200G接口下行,48个200G接口分为12个一组上行到第二级的NCF。第二级NCF采用40个平面,每个平面4台的设计,分别对应在POD内的40台NCF。整个网络的POD内实现了超速比1.1:1,而在POD和二级NCF之间实现了1:1的收敛比。

在网络通信性能提升方面,DDC基于VOQ+Cell机制,首先在发送端将从网络中接收的数据包分类到VOQs中存储,在发送数据之间会先通过Credit申请询问接收端是否有足够的缓存空间,如果没有就先在发送端的VOQ中暂存,如果有则将数据包分割成等大小的、更细粒度的Cells,并根据reachability table中cell destination的查询和采用轮询机制,均匀地在不同链路上将Cells转发到接收端进行重组和存储,再将数据包转发到网络中。从技术实现原理可见,VoQ+Cell机制实现了端到端流量调度,可充分利用缓存大幅减少丢包,且解决了ECMP策略下流量负载不均衡的问题,能有效提升宽带利用率。

同时,在DDC架构下,所有NCP和NCF可以看成一台设备,整个DDC集群内仅需单跳转发,路由设计极其简单,不仅可大幅提升路由收敛速度,易于运维管理,而且不会像传统网络那样产生多级PFC的压制与死锁。

使用OpenMPI测试套件对框式设备(框式设备和DDC原理相同,本次采用框式测试)和传统组网设备进行对比模拟测试,结果显示,在All-to-All场景下,相较于传统组网,框式设备带宽利用率提升约20%(对应GPU利用率提升8%左右)。

后记

面对业务负载激增,更具扩展性、更易运维管理、更具成本效益的分布式解耦机框方案已成为全球各大网络设备厂商、运营商和研究机构共同积极探索的技术。但一直以来,能推出可交付产品的厂商在全球范围内寥寥无几。

究其原因,其背后有较多的技术挑战需要攻关。比如,虽然DDC架构由多台NCP、NCF和NCC设备组成,但逻辑上还是一台设备,要求原先基于一台物理设备配置的所有地址表项、端口等在分布式架构中依然能保持唯一性和一致性,这需突破软件设计层面的挑战。再比如,传统一体化框式设备的接口板和交换板组件连接于单一背板,通过高速连接器互联,物理距离短,时延低;而采用DDC架构后,两者被拆解为通过光纤线缆拉远连接的NCP和NCF盒式设备,物理距离更远,且引入信元级交换后对时延要求更高,因此,如何保持低时延交换能力同样是一大挑战。

锐捷网络今年能率先推出完整的可交付“智能DDC”产品,无疑折射出其在网络设备领域的深厚实力,更重要的是,此举也给行业带来积极的带头示范意义,有望推动业界加速探索和开发更高品质、更高可靠性的计算网络方案和产品,持续为AIGC飞速发展打下坚实的基石。